文章主题:AIGC, 动漫风格图像生成, 中文动漫模型, 太乙 Stable Diffusion

2022年,AIGC领域启动,尤其在AI绘画领域,Stable Diffusion模型的应用使得动漫风格图像生成在全球范围内迅速流行。这个领域,也被称为二次元图像生成或动漫风格图像生成,已经催生了众多热门应用产品。一些知名的产品包括国外的novelai平台,以及midjourney平台的动漫专版nijijourney;在我国,则有腾讯的“异次元的我”,盗梦师平台,意间绘画平台等。这些平台为大量网民提供了便利,让他们能够创作和分享二次元动漫图像,如动漫风格的人物照、风景照、头像等,形成了的网络AI绘画热潮。除了上述商业平台,还有许多开发者者在huggingface模型开源平台开源了英文的动漫风格转换模型,例如知名的Waifu-diffusion模型,Anything-v3模型等。这些开源模型让用户、开发者和商业平台都能够自由地进行动漫图像创作。总之,这类二次元图像生成器满足了广泛的用户需求,并在市场上占据了一席之地。

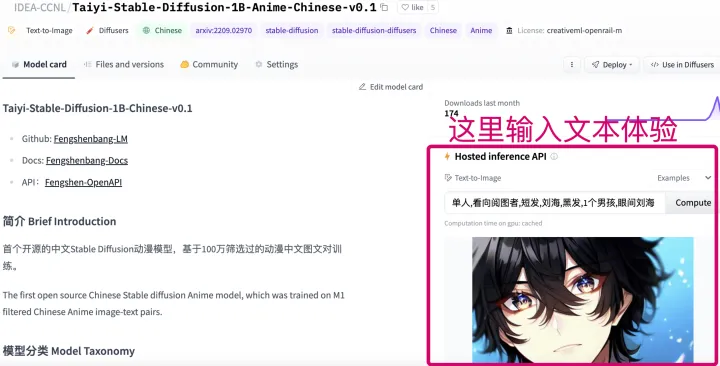

尽管当前市场上仍然缺乏公开可用的中文动漫模型,但IDEA研究院认知计算与自然语言研究中心(IDEA CCNL)已经在这方面迈出了坚实的一步。在2022年底,该中心基于 stable diffusion 模型,成功开源了首个中文动漫模型——“太乙 Stable Diffusion”。然而,这种模型在语言方面的不足以及英文模型在处理文化差异和中文独特表达时的无力感仍存在。因此,为了克服这些问题,IDEA CCNL 进一步在动漫图像基础上训练,成功研发出了首个中文动漫模型——“太乙-动漫风格 Stable Diffusion”。此模型已成功开源至Hugging Face模型平台,从而进一步推动我国动漫图像生成和创作领域的发展。

开源模型体验与下载:https://huggingface.co/IDEA-CCNL/Taiyi-Stable-Diffusion-1B-Anime-Chinese-v0.1

模型介绍

太乙-动漫风格模型是首个开源的中文动漫图像生成模型,该模型采是基于IDEA-CCNL/Taiyi-Stable-Diffusion-1B-Chinese-v0.1 模型进行继续训练得到的。我们搜集了海量的开源动漫图像数据集,这些图像绝大部分是通过一组标签来进行描述的,我们针对图像和文本进行细致的清洗和人工标注,筛选掉违规数据。经过筛选,我们得到了总量在100万左右的两份动漫图文对数据集(包含100万较低质量数据和1万高质量数据),在太乙模型基础上进行了两阶段的微调训练,训练框架使用的是封神榜团队自研并且也已经开源的Fengshenbang-LM。训练过程中我们也尝试了不同的训练策略和训练参数,比如对文本编码器和生成模型的冻结与替换等方式,对学习率、warmup等模型参数的调优),最终得到了开源的太乙-动漫风格模型IDEA-CCNL/Taiyi-Stable-Diffusion-1B-Anime-Chinese-v0.1。得益于强大的太乙 stable diffusion模型,太乙-动漫风格模型不仅能够生成精美的动漫图像,还保留了太乙模型对于中文概念强大的理解能力。

生成效果展示

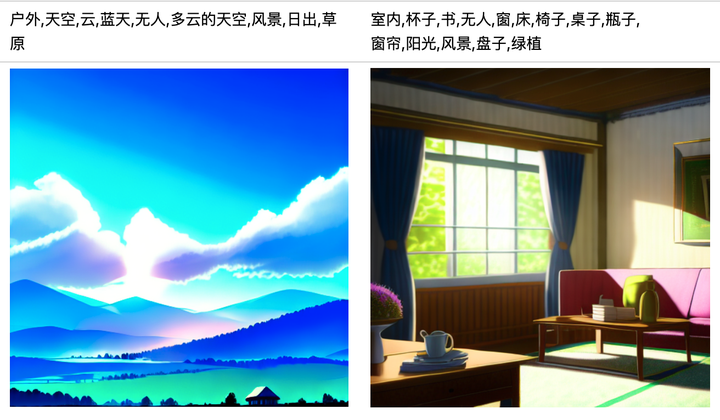

文生图

在WebUI平台上,我们的模型能够根据用户输入的一组标签,进行高效的推理,从而呈现出符合用户需求的图片。此外,我们还将推出支持完整句子输入的太乙-动漫风格模型,并将其开源,希望广大用户能够给予关注和支持。下面,我们将通过一些实例来展示太乙-动漫风格模型在人物、风景、城市和动物等方面的强大能力。

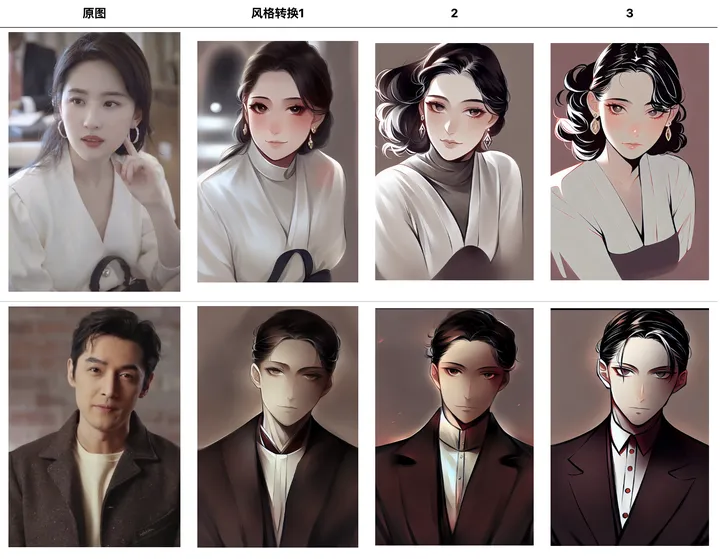

动漫风格迁移

太乙——这款动漫风格模型不仅具备将真实照片转化为精美动漫图像的能力,同时亦能实现从真实照片到动漫图像的风格转换。此外,通过调整描绘文本参数,该模型还展示出了在图片细节编辑方面的独特技巧。原图源自网络,仅用于学术研究和非商业用途。

让我们再看两个例子:

大模型的偏见、歧视问题由来已久,比如人脸识别模型不容易识别黑人,HERB这篇论文发现语言模型也存在对亚非国家存在地域歧视。比如这真实照片风格转换中,某文生图平台将把黑人小女孩识别为黑猩猩引发了社交媒体上的争议。太乙-动漫风格模型主通过对训练数据的纠偏、对prompt纠偏、调整原图的加噪强度等超参数等方式,努力解决动漫风格转换中的偏见问题。下面展示了太乙-动漫风格模型生成的三个例图(注:原图来自网络,仅作为学术研究和非商业用途):

中文理解和生成能力

太乙模型的中文理解能力颇为出色,这使得其动漫风格模型在处理中文概念和文本方面,相较于开源的英文动漫模型表现出显著的优势。因此,这一模型更适合我国用户以及创作者的使用和创作需求。

在本文中,我们对太乙模型及两个知名英文动漫模型(Waifu-diffusion-v1.3 和 Anything-v3)的图像生成效果进行了比较分析。为了测试这些模型的能力,我们将中文文本描述翻译成英文后再输入给它们进行推理。以下四幅图展示了各个模型生成的图像,从左至右分别为太乙模型、太乙-动漫风格模型、Waifu-diffusion-v1.3模型以及Anything-v3模型。

使用指南

webui使用方式

非常推荐使用webui的方式使用本模型,webui提供了可视化的界面加上一些高级修图功能。关于webui的搭建可以参考封神榜团队的文档太乙stable diffusion webui配置

善用超分模型给图片质量upup

比如这个例子:

生成图片的图片是512*512(大小为318kb):

在webui里面选择extra里的R-ESRGAN 4x+ Anime6B模型对图片质量进行超分:

想要获得2.6Mb的超高清大图,只需将图片放大至2048*2048即可。相较于512*512的图片,放大后的效果更加清晰明确。而2048*2048的高清大图则具有更好的画质,可以实现持续放大而不失真。

代码使用方式

更多使用方式和生成例子可以参考封神榜团队的文档太乙动漫绘画使用手册v1.0

太乙 – 中文AIGC模型的未来

在我国这个广阔的市场中,近10亿的文化产业正面临着AIGC(人工智能创意生成)的冲击,并迅速实现创新发展。在这些领域中,动漫风格图像生成和迁移技术无疑是其中最具潜力的一个重要方向,同时,也孕育着无数新的机遇。然而,由于之前的AIGC模型尚未能够充分理解和适应我国独特的文化背景,IDEA研究院认知计算与自然语言中心正努力打造中文认知智能基础设施,他们期望通过推出太乙系列模型,加速我国文化产业在全球市场化过程中的数字化转型和创新发展,推动各相关行业的升级。太乙所在的封神榜预训练模型开源体系,已经开放了80个模型,涵盖了AIGC、自然语言理解、受控文本生成等多个领域,成为我国最大的预训练模型开源体系。基于封神榜模型的GTS模型生产平台,能自动生产1亿参数的模型,其表现甚至超过了包括百亿、千亿参数在内的众多大型模型,进入了FewCLUE榜单的前三名。这种机器自动化生成模型的能力,已经达到了算法专家的水平,预示着AI生产AI的时代即将到来。

IDEA CCNL认为,在 AIGC 中,人的作用是更为重要的,生成式 AI 应悄无声息地融入大众生活中并更好地帮助拓展人类的想象力边界。所以,与 AI 互动生产的内容,是帮助AIGC走向下一个生产力阶段的关键。因此,IDEA CCNL除了基础模型和基础算法的研究之外,还在研究更精准的文本生成和基中文于文本的交互式图片编辑。以太乙为核心的 AIGC 模型和动漫风格迁移模型会持续更新和升级,敬请期待。

欢迎对太乙和太乙-动漫风格模型感兴趣的小伙伴们联系IDEA CCNL,一起共建中文 AIGC 和图文编辑的新世界。

封神榜相关链接:

封神榜总论文(中英双语):https://arxiv.org/abs/2209.02970封神榜主页:https://github.com/IDEA-CCNL/Fengshenbang-LM(封神榜大模型)是 IDEA 研究院认知计算与自然语言研究中心主导的大模型开源体系,成为中文认知智能的基础设施。huggingface 地址:https://huggingface.co/IDEA-CCNL封神榜 doc: https://fengshenbang-doc.readthedocs.io/zh/latest/本文使用 Zhihu On VSCode 创作并发布

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!