文章主题:DALL·E 2, 升级版本, 图像生成, 功能

在令人叹为观止方面,OpenAI 从不令人失望。

去年 1 月 6 日,OpenAI 发布了新模型 DALL·E,不用跨界也能从文本生成图像,打破了自然语言与视觉次元壁,引起了 AI 圈的一阵欢呼。

时隔一年多后,DALL·E 迎来了升级版本——DALL·E 2。

与先前的 DALL·E 相比,DALL·E 2 在生成针对用户的图像描述时展现出了更高的图像分辨率和更短的响应时间。此外,这一新版本还引入了一系列创新功能,其中包括了对原始图像的编辑 capabilities。

尽管如此,OpenAI尚未公开DALL-E 2系统,但研究人员现在已能够在线注册并预览这一平台。OpenAI的最终目标是将其整合进第三方应用程序中,以实现更广泛的应用。

试玩 Waitlist 地址:https://labs.openai.com/waitlist

OpenAI 近期发布了一篇名为《Hierarchical Text-Conditional Image Generation with CLIP Latents》的研究论文,该论文由OpenAI 研究科学家及共同第一作者 Prafulla Dhariwal 撰写。在论文中,Prafulla Dhariwal 惊叹地说:“这个神经网络的神奇之处在于,仅凭文本描述便能生成相应的图像。”

论文地址:https://cdn.openai.com/papers/dall-e-2.pdf

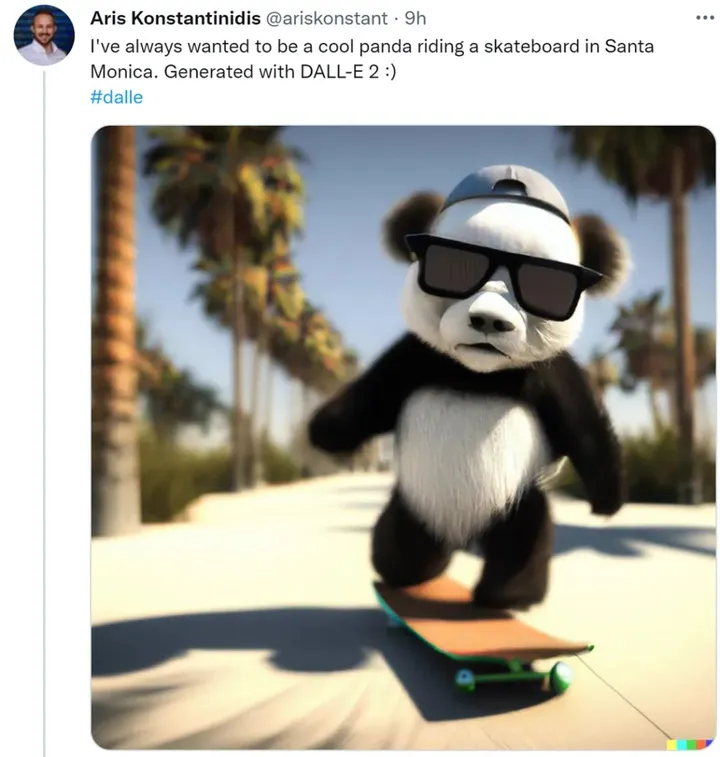

网友纷纷晒出了使用 DALL·E 2 生成的图像,比如玩滑板的熊猫靓仔。

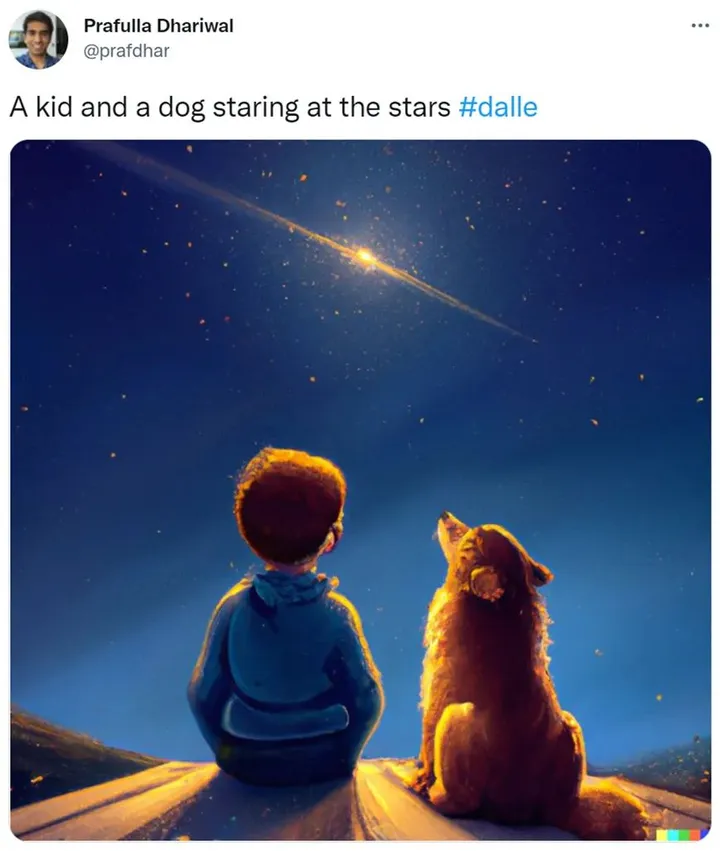

又比如席地而坐看星空的小孩和小狗。

DALL·E 2 生成艺术大作

DALL·E 2的表现究竟如何呢?让我们一探究竟。首先,DALL·E 2具备从文本描述中生成原始且逼真的图像和艺术的能力,它能够将概念、属性以及风格等因素融合在一起,从而实现图像的生成。举例来说,我们可以想象一个骑着马的宇航员,他既具有未来科技感,又保留着地球人的 familiar 味道。

官网示例展示了生成的图像有多张,达到十张。除此之外,这些图像的风格繁多,例如可以呈现一位骑着马的宇航员,呈现出各种不同的风格。

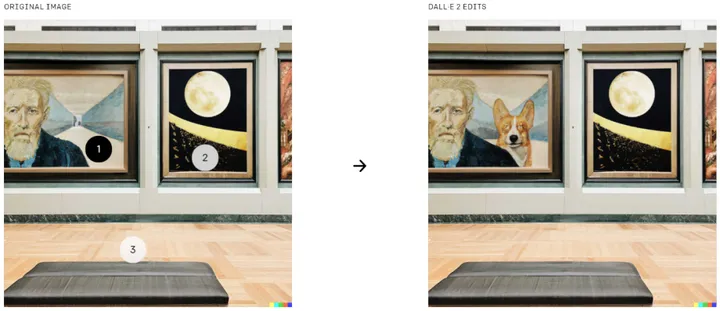

DALL·E 2是一款强大的图像编辑工具,能够根据自然语言字幕对现有图像进行精细的调整。在处理过程中,它能够充分考虑到阴影、反射和纹理等因素,实现元素的添加和删除。通过观察下面的图片,我们可以看到原始图像和经过DALL·E 2编辑后的图像。对比两张图片,我们可以发现原始图中存在着数字1、2、3,如果用户想要在这些位置添加元素,比如柯基犬,只需要点击相应的位置即可。具体操作示例如下:

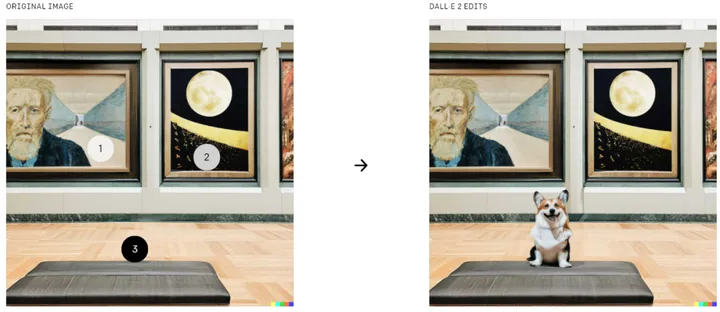

你也可以在 3 处添加一只柯基犬。

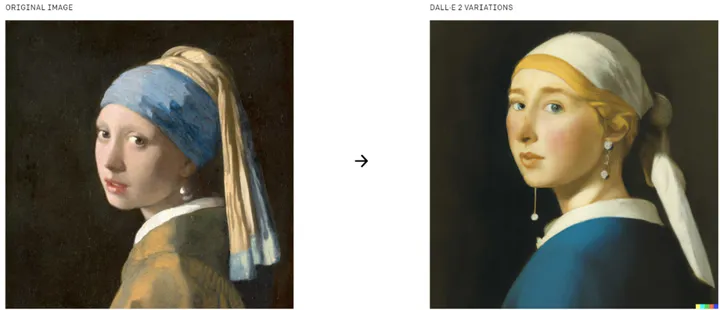

DALL·E 2 可以根据原图像进行二次创作,创造出不同的变体:

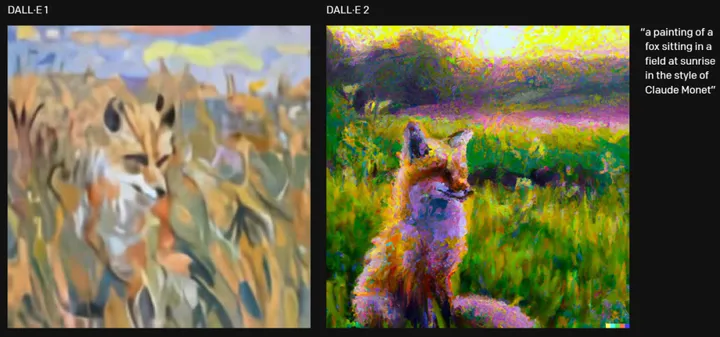

你可能会问,DALL·E 2 比一代模型到底好在哪?简单来说 DALL·E 2 以 4 倍的分辨率生成更逼真、更准确的图像。例如下图生成一幅「日出时坐在田野里的狐狸,生成的图像为莫奈风格。」DALL·E 2 生成的图像更准确。

看完上述展示,我们可以将 DALL·E 2 的特点归结如下:DALL·E 2 的一项新功能是修复,在 DALL·E 1 的基础上,将文本到图像生成应用在图像更细粒度的级别上。用户可以从现有的图片开始,选择一个区域,让模型对图像进行编辑,例如,你可以在客厅的墙上画一幅画,然后用另一幅画代替它,又或者在咖啡桌上放一瓶花。该模型可以填充 (或删除) 对象,同时考虑房间中阴影的方向等细节。

DALL·E 2 的另一个功能是生成图像不同变体,用户上传一张图像,然后模型创建出一系列类似的变体。此外,DALL·E 2 还可以混合两张图片,生成包含这两种元素的图片。其生成的图像为 1024 x 1024 像素,大大超过了 256 x 256 像素。

生成模型的迭代

DALL·E 2 建立在 CLIP 之上,OpenAI 研究科学家 Prafulla Dhariwal 说:「DALL·E 1 只是从语言中提取了 GPT-3 的方法并将其应用于生成图像:将图像压缩成一系列单词,并且学会了预测接下来会发生什么。」

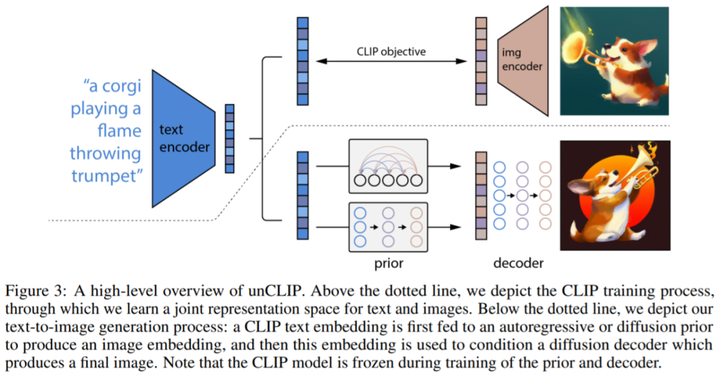

这是许多文本 AI 应用程序使用的 GPT 模型。但单词匹配并不一定能符合人们的预期,而且预测过程限制了图像的真实性。CLIP 旨在以人类的方式查看图像并总结其内容,OpenAI 迭代创建了一个 CLIP 的倒置版本——「unCLIP」,它能从描述生成图像,而 DALL·E 2 使用称为扩散(diffusion)的过程生成图像。

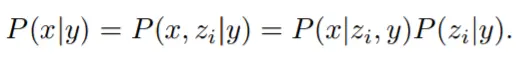

训练数据集由图像 x 及其对应的字幕 y 对 (x, y) 组成。给定图像 x, z_i 和 z_t 分别表示 CLIP 图像和文本嵌入。OpenAI 生成堆栈以使用两个组件从字幕生成图像:

先验 P(z_i |y) 生成以字幕 y 为条件的 CLIP 图像嵌入 z_i;解码器 P(x|z_i , y) 以 CLIP 图像嵌入 z_i(以及可选的文本字幕 y)为条件生成图像 x。

解码器允许研究者在给定 CLIP 图像嵌入的情况下反演图像(invert images),而先验允许学习图像嵌入本身的生成模型。堆叠这两个组件产生一个图像 x 、给定字幕 y 的生成模型 P(x|y) :

DALL·E 的完整模型从未公开发布,但其他开发人员在过去一年中已经构建了一些模仿 DALL·E 功能的工具。最受欢迎的主流应用程序之一是 Wombo 的 Dream 移动应用程序,它能够根据用户描述的各种内容生成图片。

OpenAI 已经采取了一些内置的保护措施。该模型是在已剔除不良数据的数据集上进行训练的,理想情况下会限制其产生令人反感的内容的能力。

为避免生成的图片被滥用,DALL·E 2 在生成的图片上都标有水印,以表明该作品是 AI 生成的。此外,该模型也无法根据名称生成任何可识别的面孔。

DALL·E 2 将由经过审查的合作伙伴进行测试,但有一些要求:禁止用户上传或生成「可能造成伤害」的图像。他们还必须说明用 AI 生成图像的作用,并且不能通过应用程序或网站将生成的图像提供给其他人。

但 OpenAI 希望稍后再将 DALL·E 2 其添加到该组织的 API 工具集中,使其能够为第三方应用程序提供支持。Dhariwal 说:「我们希望分阶段进行这个过程,以从获得的反馈中不断评估如何安全地发布这项技术。」

参考链接:

https://www.theverge.com/2022/4/6/23012123/openai-clip-dalle-2-ai-text-to-image-generator-testing

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!