西风 发自 凹非寺

量子位 | 公众号 QbitAI

“比Sora还震撼”,AI可以实时生成游戏了!

谷歌DeepMind打造出了首个完全AI驱动的实时游戏引擎——GameNGen。

在单个谷歌TPU上,它以每秒20帧模拟起了经典射击类游戏DOOM(毁灭战士)。

所有游戏画面都是根据玩家操作,与复杂环境进行交互,实时生成。

也就是说你走进一道门之前,门后的内容还不存在。

质量不输事先存储的那种,能“以假乱真”,人类评估者都难以察觉。

各种操作都能丝滑转换:

GameNGen的背后是大家熟悉的扩散模型。

从论文题目就重新定义了游戏引擎:扩散模型是实时游戏引擎。

网友们看到这项研究一时间炸开了锅,推特、Reddit上相关帖子热度持续不减,谁发谁火。

不少人表示它提供了一条全新的技术路径:

我觉得人们还没有意识到这有多疯狂。我是一名开发人员,专门负责将生成式AI集成到游戏引擎中,所以我很清楚我在说什么。

这是构建虚拟事物的基础。未来它或许能够普及到它能够获取数据的任何视频游戏,随后,可能还能为尚未存在的游戏生成数据,创造新游戏。

作者Shlomi Fruchter也开麦了:

这对我来说是一个个人里程碑,也是从手工编写在GPU上运行的显式渲染代码到训练同样在GPU上运行的神经网络的完整回环,感觉圆满了。

那么,GameNGen究竟是如何做到的?

用扩散模型造AI DOOMers

GameNGen训练过程分为两个主要阶段。

首先,训练一个强化学习Agent来玩游戏,并记录过程中所有动作、技能和观察数据。这些记录成为第二阶段的训练数据集。

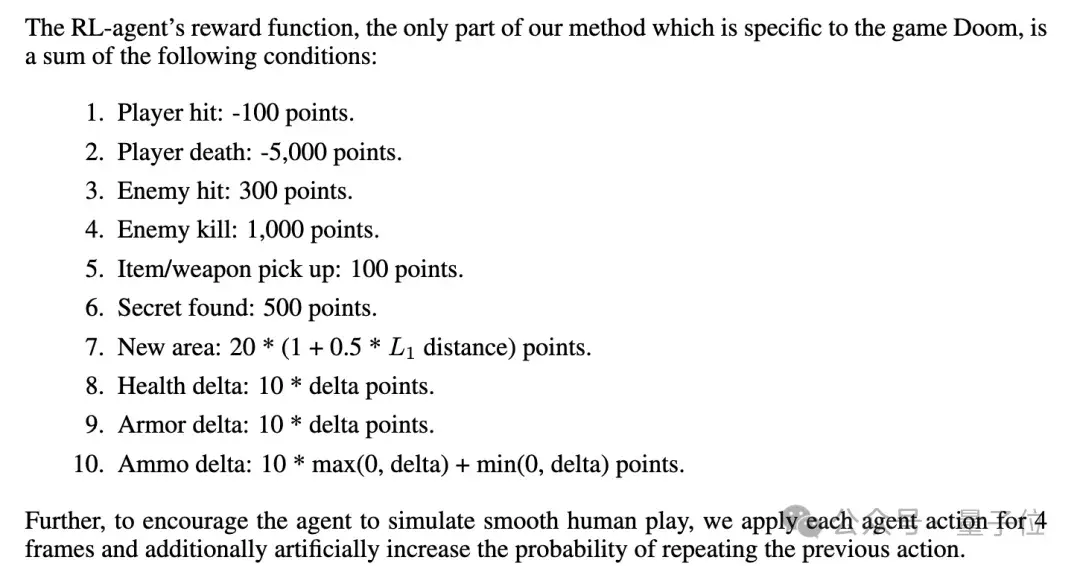

为生成尽可能贴近人类游戏行为的训练数据,研究人员设计了一个简单的、特定于环境的奖励函数,根据一系列特定的游戏情况来分配分数,条件包括:

玩家被击中、敌人被消灭、捡起物品或武器、生命值变化、弹药变化……

在第二阶段,基于预训练的Stable Diffusion v1.4来预测下一帧,模型以过去的帧序列和动作作为条件输入,并进行了一些关键修改。

具体来说,首先移除了所有文本条件,替换为动作序列。每个动作被编码为一个单一的token,通过交叉注意力机制与模型交互。

历史观察(即之前的帧)被编码到潜在空间,并与当前噪声化的潜在表示在通道维度上拼接。

为了解决自回归生成中的误差累积,即自回归漂移问题,GameNGen引入了噪声增强技术。

在训练时,模型对输入的上下文帧添加不同程度的高斯噪声,并将噪声级别作为额外输入提供给模型。这使得模型能够学习纠正之前采样中的错误,对维持长时间序列的图像质量至关重要。

此外,为了提高图像质量,特别是在细节和HUD(平视显示器)方面,研究者对Stable Diffusion的预训练自编码器的解码器部分进行了微调。这个过程使用MSE损失,针对目标帧像素进行优化。

在推理阶段,GameNGen使用DDIM采样方法,并采用了无分类器引导技术,但仅用于过去观察的条件。研究者发现,对过去动作条件使用引导并不能提高质量。

值得注意的是,模型仅使用4步DDIM采样就能产生高质量的结果,这大大提高了生成速度。

GameNGen在TPU-v5硬件上运行,单个去噪器步骤和自编码器评估各需要10毫秒。

通过使用4步采样和单次自编码器评估,系统能够达到每秒20帧的生成速度,足以实现实时交互式游戏体验。

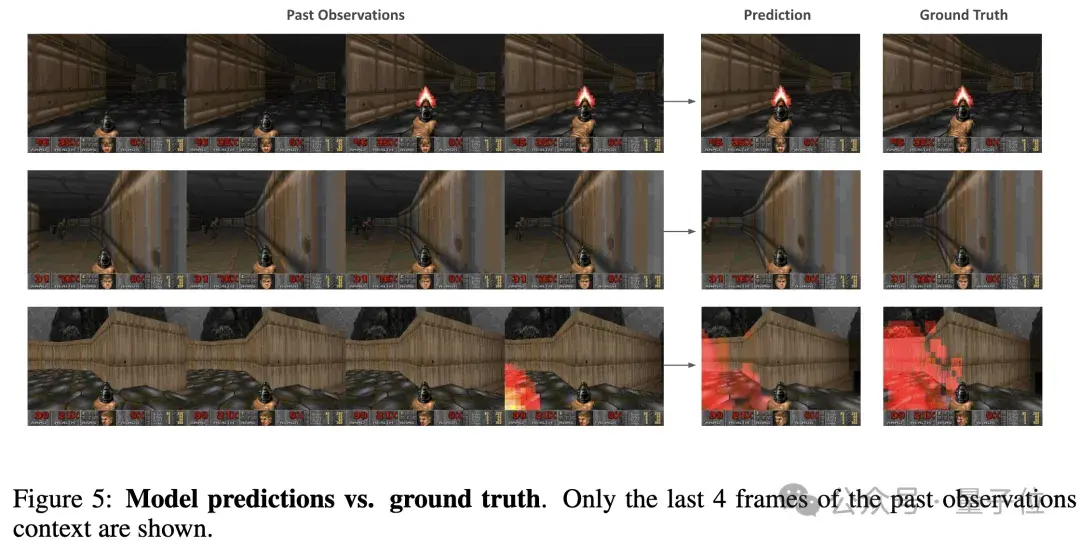

人类难以分辨真实和AI生成

实验中,在短时轨迹上,人类评估者几乎无法区分模拟画面与实际游戏画面。

研究人员使用了两种主要的图像质量评估方法:基于感知的图像相似度度量方法LPIPS和衡量图像质量的常用指标PSNR。

在teacher-forcing设置中,模型单帧预测质量PSNR为29.43,LPIPS为0.249。PSNR的值与20-30质量设置下的有损JPEG压缩相似。

换句话说,GameNGen在模拟图像时能够在一定程度上保持较高的视觉质量,尽管可能存在一些压缩带来的细节损失。

视频质量方面,对于长度为16 帧(0.8 秒)和32帧(1.6 秒)的模拟,FVD分别为114.02、186.23。

在人类评估方面,研究人员为10 名人类评估者提供了130个随机短片段(1.6秒和3.2 秒的长度),并将模拟与真实游戏并排展示。

在1.6秒和3.2秒的片段中,人类仅有58%、60%的概率能正确区分真实游戏和模拟。

基于Diffusion的最新突破

除了被效果惊艳到,不少研究者还表示这项研究没有那么简单,它是一种基于扩散模型的最新突破。

动作条件化的世界模型已更进一步!神经网络模拟在扩展实际交互数据方面具有巨大潜力,特别是在物理模拟器表现不佳的领域。

不过,在一片好评声中,也有网友指出,论文很好,但称其为“游戏引擎”不太妥当:

希望他们能说“渲染引擎”而不是“游戏引擎”。

游戏引擎是一个让一群人创造东西的工具,它将继续存在,特别是与任何集成的超级AI共存。显然,今天的游戏引擎已经过时,但我们已经在构建下一代引擎了。

对于一些人评论这些模型将取代传统游戏引擎,也有网友持不同的观点。

一位a16z的游戏和3D技术领域投资人、前Unity员工给出了他的看法:

讽刺的是,训练这些模型需要从传统游戏引擎输入控制器动作和输出帧作为训练数据。

虽然我认为这些由扩散模型实时生成的帧最终会改变我们体验游戏的方式,但我仍然认为专业开发者需要一个3D场景图来进行触感控制和创造性表达。

开发者可能会使用更传统的3D创作引擎创建游戏的“灰盒”版本,然后一个图像到图像的模型实时提升分辨率(类似于英伟达的DLSS技术)。

未来,消费者将能体验从文本直接创造游戏或虚拟世界的全新方式。但在我看来,专业工作流程中仍然会有3D场景图的一席之地。

你怎么看GameNGen这项研究?它会给未来游戏行业带来何种改变?

项目主页:https://gamengen.github.io/论文链接:https://arxiv.org/pdf/2408.14837

参考链接:[1]https://www.reddit.com/r/singularity/comments/1f3055r/google_deepmind_we_present_gamengen_the_first/[2]https://x.com/_akhaliq/status/1828631472632172911[3]https://x.com/imxiaohu/status/1828732438056755383

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态