2024年,AI绘画技术已经日新月异,但仍有不少工具依赖于关键词描述,无论是Midjourney还是Stable Diffusion,都需要用户提供详细的关键词描述。尽管聪明的用户可以借助大语言模型(如GPT-4)自动生成关键词,但这仍旧不是最直观的方式。

今天,我们要介绍的是Omost——一个真正理解你的AI绘画工具。

github项目,stars飙升。

Omost不仅是ControlNet作者倾力打造的创新项目,更是一场图像生成技术的革命。Omost通过将大型语言模型(LLM)的强大编码能力转化为直观且高效的图像生成能力,带来了前所未有的创作体验。

Omost的独特之处

Omost的核心技术在于其独特的图像合成方法,能够深刻理解并响应极短的提示词,生成既详细又空间表现准确的图像。这意味着即使你对图像生成技术不甚了解,也能轻松生成令人惊叹的视觉作品。

项目名称“Omost”寓意深远,其中“O”代表“omni”多模态,象征着项目支持多种形式的输入与输出;“most”则表达了项目挖掘LLM模型潜力的决心,力求从每一个细节中释放出最多的图像生成可能性。

技术亮点

自动扩展提示词:Omost能够将简单的提示词拆解成详细的描述,生成符合你预期的完整图像。高灵活性:生成的图像可以轻松调整,用户可以通过简单的提示词对图像中的某个元素进行修改。图像位置编码:通过将图像划分为729个不同的位置,确保生成图像的准确性和细致度。子提示系统:Omost的LLM可以提供严格定义的“子提示”,大幅提高提示词的灵活性和准确性。注意力操纵:通过调整注意力分数,Omost能够实现更精细的图像生成。提示前缀树:通过提示前缀树技术改进提示理解和描述,确保生成图像与提示词高度一致。Omost的应用

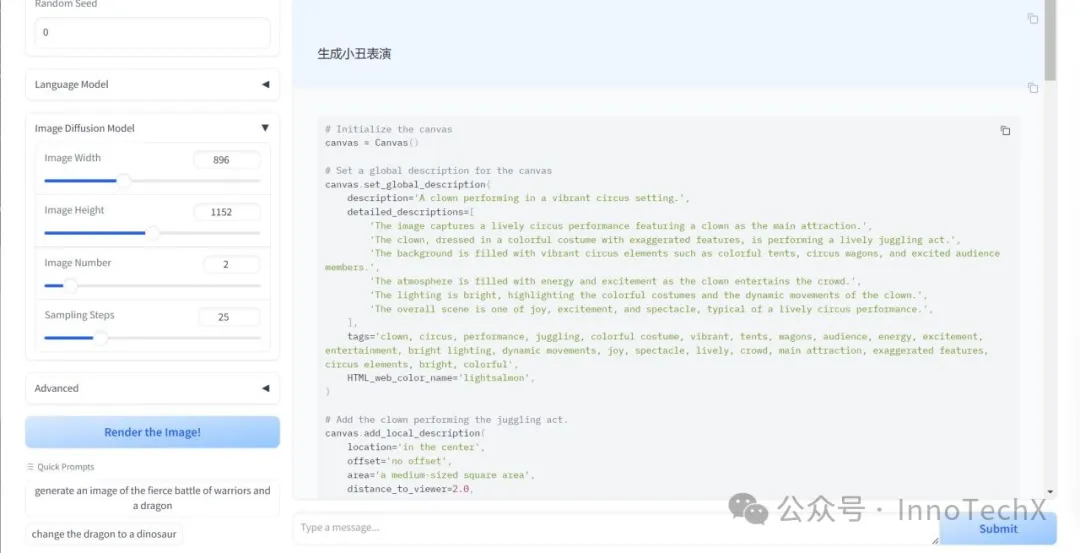

Omost的背后是经过混合数据训练的LLM模型,这些模型不仅能够编写代码,还能与内置的虚拟画布代理紧密协作。用户只需简单描述所需画面,虚拟画布代理便会理解并转化为视觉指令代码,并最终生成符合要求的图像。

更为重要的是,你可以将Omost生成的关键词复制到其他AI绘画软件中,比如Stable Diffusion,同样能够生成酷炫的效果。

获取指南

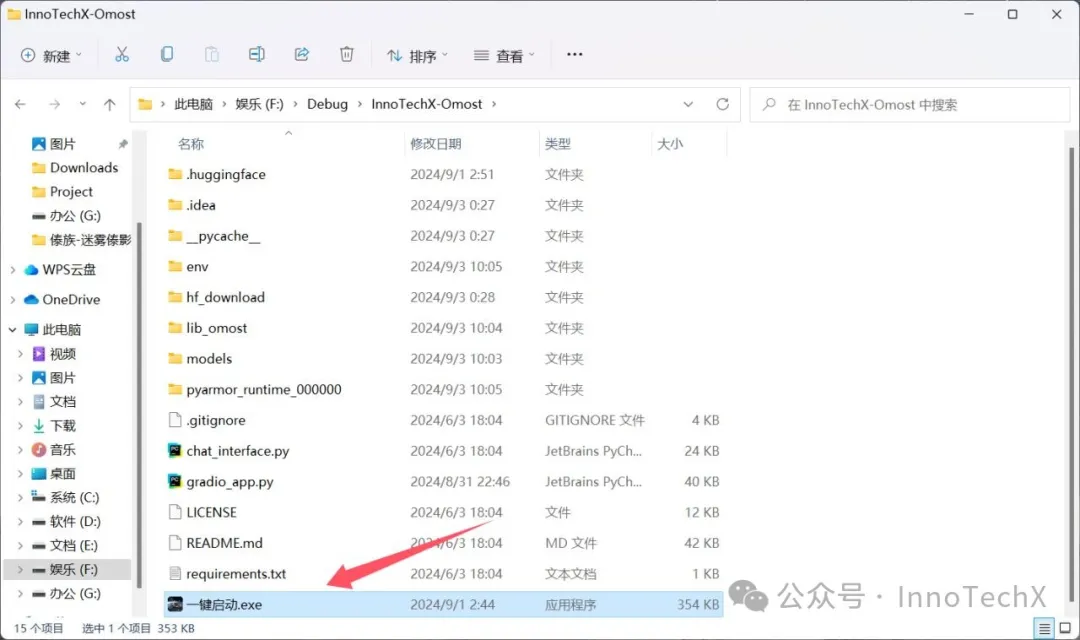

一键启动:无需复杂配置,下载后解压直接点击 一键启动.exe,即可启动程序。下载速度取决于您的网速,无需开通会员。InnoTechX

发送

前置条件

此一键包win10、win11可用,并且需要配备至少8GB显存的 NVIDIA 显卡。cuda版本需要大于等于12.1,如果cuda版本小于12.1,可以按照教程按装指定版本的cuda [https://www.zhisk.com/1154.html]。

cuda查询cmd指令

nvcc –version

或:

nvidia-smi

(请注意某些 9XX 或 10XX 或 20XX GPU 可能无法正常运行,具体自测)

使用步骤

下载并解压整合包到本地目录。进入目录后,点击 一键启动.exe 启动程序。注意:程序运行期间,请勿关闭 CMD 命令窗口。

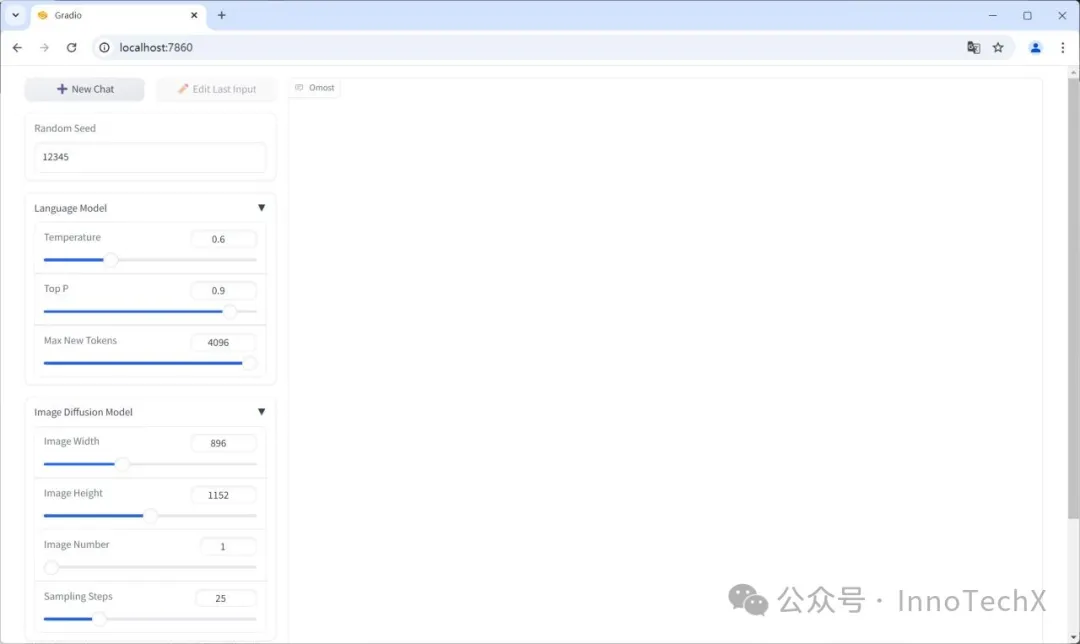

点击启动后会自动打开网页跳转到 http://localhost:7860/ 没有就自行复制到浏览器打开

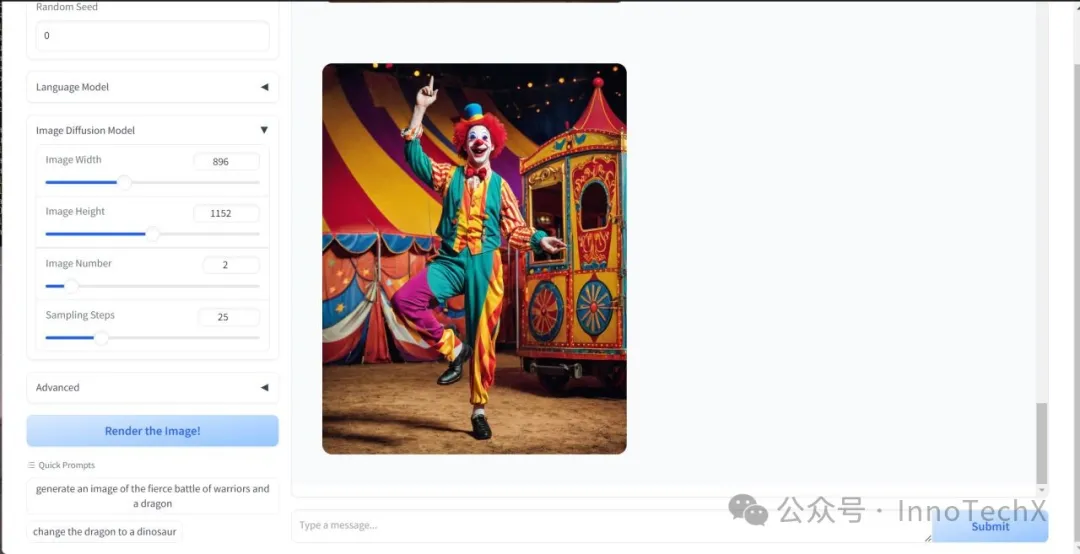

生成结果

你也可以将已经生成的视觉内容的关键词复制到Stable Diffusion中去绘画,比如我随便找了一个在线Stable Diffusion平台

将tags内容复制过去

这平台免费的还要排队,无语,第一次生成等了半天,还给我吃了。

再次排队后生成,再等待了九九八十一分钟后,终于出图了。

真是受不了这平台,等待太慢。共用GPU服务器资源还是垃圾,自己显卡好情愿用自己电脑跑。

下期文章还是出一个Stable Diffusion的极简中文离线整合包以及优质真人模型推荐。