智慧启航,AI引领未来!加入公众号,紧跟AI发展步伐,探索最新AI应用,用智能工具助力您的创新之路!

文章主题:stable diffusion, text2img, img2img, DALL-E

近期,各大平台纷纷涌现出stable diffusion技术的实际应用案例,无论是text2img还是img2img的转换,都呈现出令人惊艳的成果。

尽管功能相似的DALL-E已经在市场上存在相当长的时间,甚至在性能上更为卓越,但是,与DALL-E相比,stable diffusion模型的开源影响力和价值却是不可忽视的。就像投入水中的一颗石子引发连串的涟漪效应,催生了众多新的服务和网站,这种现象让人惊讶不已:为何它会如此火爆呢?

相关资源

这里简单罗列下stable diffusion相关的各类资源,包括代码、模型等等。

官网:https://ommer-lab.com/research/latent-diffusion-models/论文:https://arxiv.org/abs/2112.10752Github地址:https://github.com/CompVis/stable-diffusion模型下载地址: https://huggingface.co/CompVis/stable-diffusion-v1-2https://huggingface.co/CompVis/stable-diffusion-v1-4/tree/main/safety_checkerhuggingface权限申请

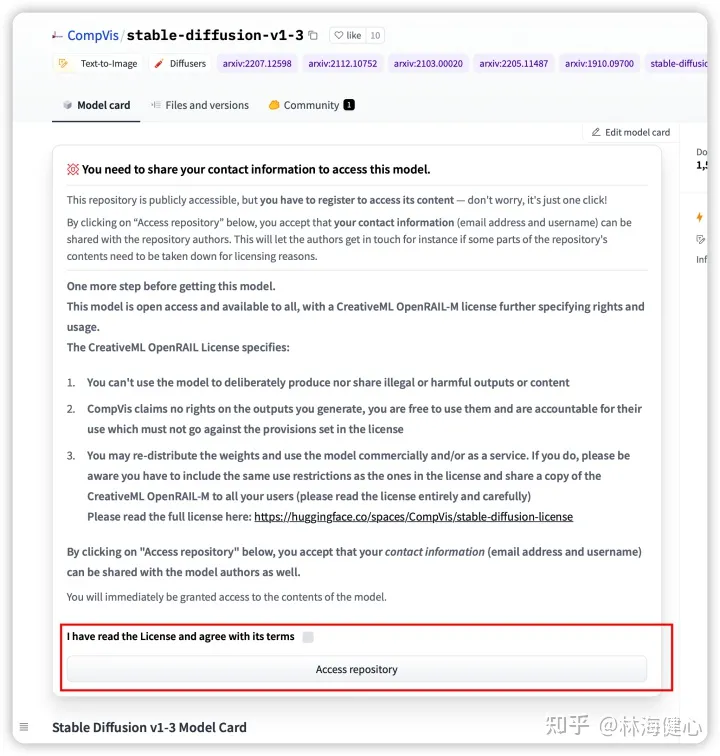

Stable Diffusion模型已在Hugging Face上正式开源并发布,其主页详细介绍了如何使用这些模型。然而,这类生成式模型的潜在滥用风险需要注意。因此,我们建议您先在Hugging Face上注册个人账号,然后申请相关权限以实际使用。这样一来,既保证了合法合规的使用,也避免了模型被滥用的情况。

注册账号后,在https://huggingface.co/settings/tokens可以得到对应的tokens,然后本地huggingface-cli login后输入,就可以愉快的使用stable diffusion的相关模型了。如果没有token,代码运行会报错:

另外Access repository后,就可以下载模型了。

依赖库安装

huggingface中所提供的示例代码,所依赖的是diffusers这个库,访问这个库的GitHub地址:https://github.com/huggingface/diffusers,官方的说法是pip安装就可以。

在实际测试中,我们发现PIP默认安装的版本为0.1.2,而非推荐版本0.2.4。此外,即便强行安装了0.2.4,img2img和in-painting所依赖的类也并未在该包中出现。因此,我们更为推荐的方式是在克隆GitHub仓库至本地后,利用python3 setup.py install进行安装。

text2img测评

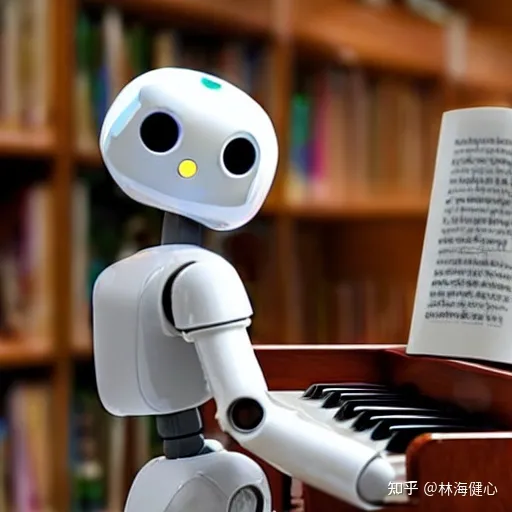

简单测评下text2img的功能:输入一段text文字,模型会基于这段描述性文字生成图像img。

代码使用官方提供的示例就可以,由于模型已经下载,因此将路径指定为模型地址即可:

其中pipe的结构如下:

随意测试了一些prompt的生成效果如下:

a photo of a flying dog

在众多图像生成效果中,多数呈现出令人满意的结果。然而,有一部分图像在处理中国女性时出现了问题,引发了关于是否存在对亚洲人面部特征的歧视争议。这让人不禁怀疑训练数据是否受到了某种偏见影响。

在线资源

除了通过本地下载模型调试代码,stable diffusion还有很多开源的服务,便于做快速测试。 以https://huggingface.co/spaces/stabilityai/stable-diffusion 为例,同样可以输入一句prompt生成图像,不过由于资源紧张需要排队使用,排队时间也可能比较长。

这里同样测试了几个prompt,效果如下:

a photo of a smiling Chinese women

嗯,看起来训练数据的眯眯眼问题是没跑了。

此外,还有一个开源的prompt网站:https://lexica.art/,可以提供参考的prompt用于生成图像,支持DALL-E,stable diffusion等模型。

目前,Stable Diffusion的相关服务尚不健全。在此,我们摘录了部分DALL-E的提示以及相应的图像示例,以供参考。

ultra nekopara fantastically detailed reflecting eyes modern anime style art cute detailed ears cat girl neko dress portrait shinkai makoto vibrant Studio ghibli kyoto animation hideaki anno Sakimichan Stanley Artgerm Lau Rossdraws James Jean Marc Simonetti elegant highly detailed digital painting artstation pixiv cyberpunk

小结

近年来,人工智能的推广和发展受到了广泛的关注。尽管人工智能在某些方面仍然存在不足,如被戏称为“人工智障”,并且自动驾驶技术的发展仍处于初级阶段,但它所代表的图像生成技术却已经走在了大众生活的前沿。这种技术有着巨大的潜力,有可能成为一种新的UGC(用户生成内容)工具。对于人工智能的普及,人们早已不再陌生。然而,人工智能的应用并不仅限于那些被广泛讨论的高科技领域。如今,通过 stable diffusion 技术生成的图像,已经开始向大众生活靠拢。这种技术的出现,标志着图像生成技术已经取得了重大突破,使得人工智能的应用范围进一步扩大。与此同时,我们也不能忽视自动驾驶技术的发展。虽然下围棋仍然是少数人的爱好,但自动驾驶技术已经在逐渐接近普通人的生活。它不仅能够提高交通效率,降低交通事故率,还能够为人们的出行提供更多便利。因此,自动驾驶技术的发展具有非常广阔的前景。总的来说,人工智能的发展和应用已经取得了显著的成果。而 stable diffusion 代表的图像生成技术,更是为我们带来了一种全新的体验。我们有理由相信,随着人工智能技术的不断进步,未来会有更多的技术应用于我们的生活,让我们的生活更加美好。

欢迎关注我的公众号“言木木的佳常菜” 相关文章会在公众号第一时间发布,知乎同步更新~

stable diffusion, text2img, img2img, DALL-E

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!