AI赋能未来,让生活更精彩!关注公众号,了解最新AI趋势,使用顶尖AI工具,共创智能化美好生活!

文章主题:合作, @cloneofsimo, Dreambooth, 全微调方法

LoRA: Low-Rank Adaptation of Large Language Models 是微软研究员引入的一项新技术,主要用于处理大模型微调的问题。目前超过数十亿以上参数的具有强能力的大模型 (例如 GPT-3) 通常在为了适应其下游任务的微调中会呈现出巨大开销。 LoRA 建议冻结预训练模型的权重并在每个 Transformer 块中注入可训练层 (秩-分解矩阵)。因为不需要为大多数模型权重计算梯度,所以大大减少了需要训练参数的数量并且降低了 GPU 的内存要求。研究人员发现,通过聚焦大模型的 Transformer 注意力块,使用 LoRA 进行的微调质量与全模型微调相当,同时速度更快且需要更少的计算。

用于 Diffusers 的 LoRA

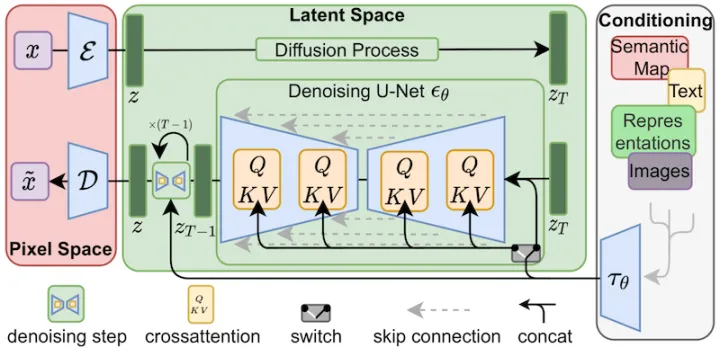

尽管 LoRA 最初是为大模型提出的,并在 transformer 块上进行了演示,但该技术也可以应用于其他地方。在微调 Stable Diffusion 的情况下,LoRA 可以应用于将图像表示与描述它们的提示相关联的交叉注意层。下图的细节 (摘自 Stable Diffusion 论文) 并不重要,只需要注意黄色块是负责建立图文之间的关系表示就行。

潜在扩散架构

据我们所知,Simo Ryu (GitHub 用户名 @cloneofsimo) 是第一个提出适用于 Stable Diffusion 的 LoRA 实现的人。如果想查看相关示例和许多其他有趣的讨论和见解。请一定要看看 他们的 GitHub 项目。

为了将 LoRA 的可训练矩阵注入到与交叉注意力层一样深的模型中,过去人们需要以富有想象力 (但脆弱) 的方式破解 diffusers 的源代码。如果 Stable Diffusion 向我们展示了一件事,那就是社区总是会想出办法来改变和调整模型以达到创造性目的,我们喜欢这样!由于许多其他原因,提供操纵交叉注意力层的灵活性可能是有益的,例如更容易采用 xFormers 等优化技术。 Prompt-to-Prompt 等其他创意项目可以使用一些简单的方法来访问这些层,因此我们决定 为用户提供一种通用的方法来做到这一点。自 12 月下旬以来,我们一直在测试,并在我们的 diffusers 中正式发布。

我们始终与@cloneofsimo展开合作,为Dreambooth以及全微调方法提供Diffusions中LoRa训练的支持。这些创新技术所带来的优势包括:

更快的训练速度计算要求较低。我们可以在具有 11 GB VRAM 的 2080 Ti 中创建一个全微调模型!小了很多的训练模型。由于原始模型已冻结,我们注入了新层进行训练,因此我们可以将新层的权重保存为大小约为 3 MB 的单个文件。这比 UNet 模型的原始大小小一千倍

我们对最后一点特别兴奋。为了让用户分享他们出色的微调或 dreamboothed 模型,他们必须分享最终模型的完整副本。其他想要试用它们的用户必须在他们最喜欢的 UI 中下载经过微调的权重,这会增加大量存储和下载成本。截至今天,大约有 1,000 个 Dreambooth 模型在 Dreambooth 概念库中注册,可能还有更多未在库中注册。

使用 LoRA,现在可以发布 单个 3.29 MB 文件 以允许其他人使用你的微调模型。

我特别感谢 GitHub 用户 @mishig25 的贡献。他是第一个将 ‘dreamboothing’ 作为动词的使用者,这一用法在我的认知中尚未出现。

LoRA 微调

Stable Diffusion 的全模型微调过程既耗时又具有挑战性,这也是为什么像Dreambooth或Textual Inversion等轻量级方法越来越受到欢迎的部分原因。然而,利用LoRA技术,在定制数据集上进行模型微调变得更加便捷。

Diffusers 现在提供了一个 LoRA 微调脚本,可以在低至 11 GB 的 GPU RAM 中运行而无需借助到诸如 8-bit 优化器之类的技巧。这里展示了您如何借助它来使用 Lambda Labs Pokémon 数据集 微调模型:

export OUTPUT_DIR=”/sddata/finetune/lora/pokemon”

export HUB_MODEL_ID=”pokemon-lora”

export DATASET_NAME=”lambdalabs/pokemon-blip-captions”

accelerate launch –mixed_precision=”fp16″ train_text_to_image_lora.py \

–pretrained_model_name_or_path=$MODEL_NAME \

–dataset_name=$DATASET_NAME \

–dataloader_num_workers=8 \

–resolution=512 –center_crop –random_flip \

–train_batch_size=1 \

–gradient_accumulation_steps=4 \

–max_train_steps=15000 \

–learning_rate=1e-04 \

–max_grad_norm=1 \

–lr_scheduler=”cosine” –lr_warmup_steps=0 \

–output_dir=${OUTPUT_DIR} \

–push_to_hub \

–hub_model_id=${HUB_MODEL_ID} \

–report_to=wandb \

–checkpointing_steps=500 \

–validation_prompt=”Totoro” \

–seed=1337

这里需要注意的一件事是学习率为“1e-4”,远大于常规微调的通常学习率 (通常为“~1e-6”的数量级)。这是上次运行的 W

合作, @cloneofsimo, Dreambooth, 全微调方法

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!